|

Hace tiempo que Facebook trabaja con terceros para potenciar su sistema de moderación, aunque esta dinámica se basaba solamente en la revisión de artículos. Pero esto va a cambiar, ya que anunció que están extendiendo su programa de comprobación de hechos y fotografías, a unos 27 socios en 17 países.

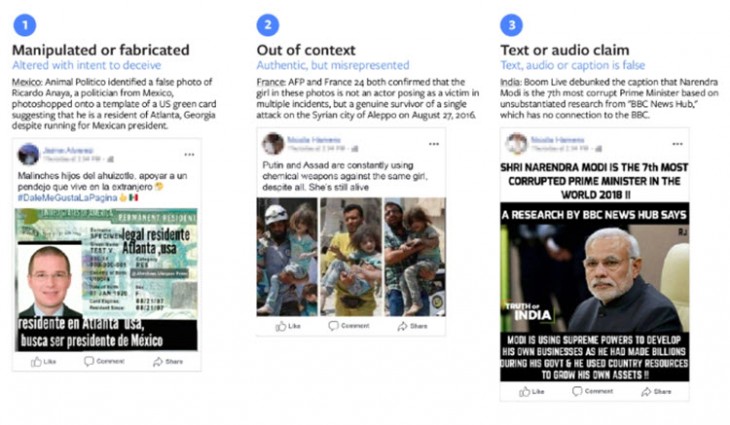

Este programa, cuenta con el potencial del aprendizaje profundo, que puede identificar diferentes marcadores que alertan que podría tratarse de contenido manipulado, fuera de contexto o totalmente falso. En la siguiente etapa, esa información es analizada por moderadores especializados, que aplican diferentes técnicas para evaluar la veracidad del contenido.

Es decir, combinan diferentes tecnologías, el potencial de la IA y el trabajo de especialistas para moderar el contenido, y quitarlo de la plataforma, si es que resulta falso. Así que, Facebook espera que al extender esta dinámica, puedan identificar este tipo de contenido de manera más efectiva y rápida, aunque reconocen que aún tienen mucho trabajo por realizar para optimizar su sistema:

Sabemos que luchar contra las noticias falsas es un compromiso a largo plazo, ya que las tácticas utilizadas por los malos actores siempre cambian. A medida que actuamos a corto plazo, también continuamos invirtiendo en más tecnología y asociaciones para poder adelantarnos a nuevos tipos de desinformación en el futuro.

No hay comentarios:

Publicar un comentario