|

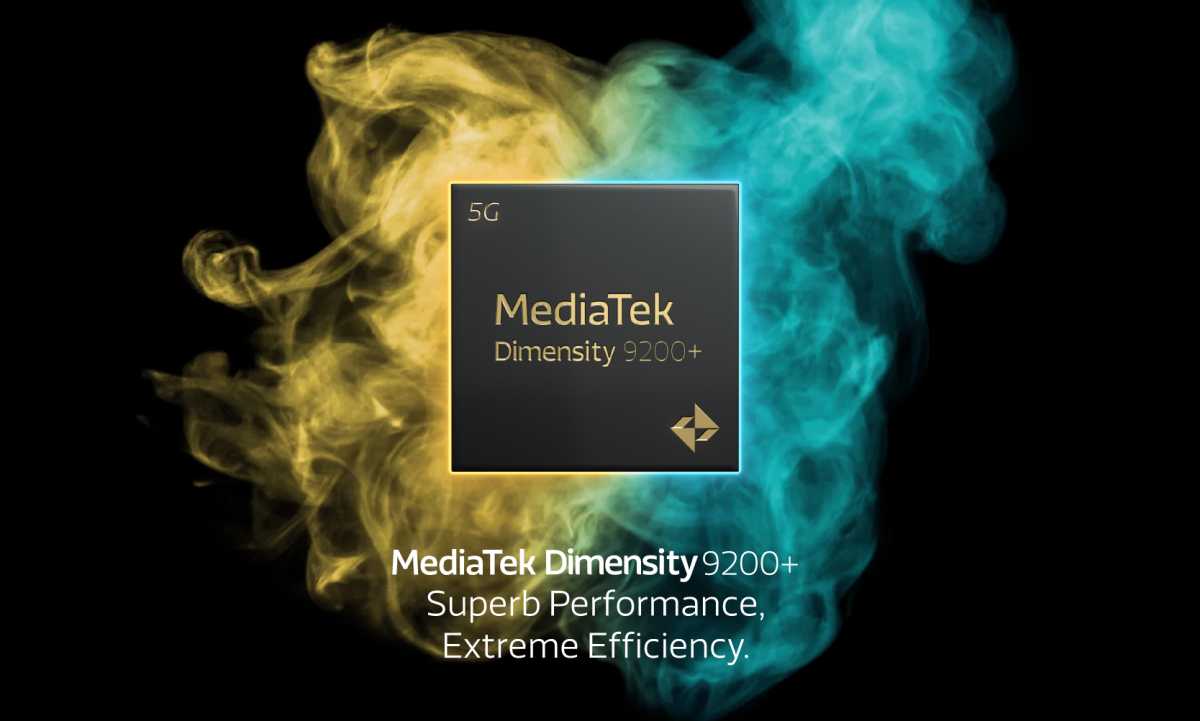

MediaTek sigue aumentando su cartera de chipsets para teléfonos móviles inteligentes anunciando en el día de hoy una serie de modelos, entre los que destaca claramente el nuevo Dimensity 9200+, orientado a los teléfonos móviles inteligentes de gama alta.

Dimensity

9200+ es básicamente la versión actualizada del MediaTek Dimensity 9200

lanzado el pasado año para competir con los chipsets de gama alta de

Qualcomm para móviles inteligentes, aportando mejoras de rendimiento y

mayores eficiencias energéticas, sobre todo, en tareas bastante

intensivas.

Aumento de velocidades de los núcleos, mayor eficiencia energética, y más

La estructura del nuevo Dimensity 9200+ está basada en ocho núcleos, con cuatro núcleos de rendimiento estando el ultranúcleo Arm Cortex-X3 a 3,35GHz junto a tres supernúcleos Arm Cortex-A715 a 3,0GHz, y cuatro núcleos de eficiencia Arm Cortex-A510 a 2,0GHz, estando fabricado en un proceso de 4 nm de segunda generación de TSMC.

El nuevo Dimensity 9200+ utiliza la GPU Arm Immortalis-G715, que cuenta con once núcleos, y que según afirma la compañía, consigue un aumento del rendimiento en general del 17%, albergando además mejoras en la tecnología de trazado de rayos para hacer frente a los detalles de los objetos en los complejos escenarios de iluminación.

A nivel de conectividad, MediaTek dice que el nuevo Dimensity 9200+ cuenta con un módem 5G compatible con conexiones sub-6GHz de largo alcance y con conexiones mmWave súper rápidas, siendo también compatible con redes Wi-Fi 7 con hasta 6,5 Gbps en velocidad de datos, junto con Bluetooth 5.3.

Agregan que la tecnología de coexistencia Bluetooth y Wi-Fi de MediaTek posibilita que el Wi-Fi, el audio Bluetooth de baja energía (LE) y los periféricos inalámbricos se conecten al mismo tiempo con una muy baja latencia y sin inferencias.

Principales características

Como principales características del nuevo chipset desde MediaTek señalan a HyperEngine 6.0 como tecnología de rendimiento que permite potenciar los juegos con altas tasas de cuadros.

También cuenta la sexta generación de su unidad de procesamiento de IA, APU 690, que potencia funciones de cámara, y la integración del procesador de señal de imagen insignia MediaTek Imagiq 890, que permite conseguir imágenes y vídeos brillantes incluso en bajas condiciones de iluminación.

También se caracteriza por integrar a MediaTek MiraVision 890 para conseguir una visualización fluida con una tasa de refresco adaptativo y MediaTek 5G UltraSave 3.0 como tecnología de eficiencia energética que logra una mayor duración de la batería bajo conectividad 5G.

Para este mes de mayo llegarán los primeros modelos con el nuevo chipset

La compañía señala que los primeros modelos de móviles con el nuevo chipset insignia llegarán este mismo mes de mayo, por lo que no habrá que esperar mucho, si bien hay quienes piensan que móviles con el nuevo chipset insignia tarden en llegar a los Estados Unidos.

Más información/Crédito de la imagen: MediaTek